“咔哒”一声 暴风小魔投让你静下来好好看一场电影 原创

至顶网个人商用频道 05月24日 北京消息(文/陶婧婕)昨日,暴风集团在北京举办了题为“好好看一场电影”的暴风小魔投新品发布会。本场发布会的演讲环节设计呼应主题,暴风集团CEO冯鑫大部分时间都是坐在沙发上讲述小魔投的产品参数、功能,发布会现场俨然变成由冯鑫配音、小魔投主演的一部“电影”。

冯鑫表示,(小魔投)是一个惦记很久,又差点被放弃掉的产品。为什么这么说?当初做这款产品时,暴风内部争执很多,例如在产品规划上,APP首页到底放多少部电影、是否真的彻底舍弃遥控器等等,冯鑫自己也犹豫过。但,他最后还是选择要做小魔投。“毕业25年,我要为自己做一个产品,并且,为它代言。”

绕不过的硬件参数

小魔投的定位是“便携式投影”,用户无论在何地,只要找一面墙或者天花板,就能静下心来看电影。

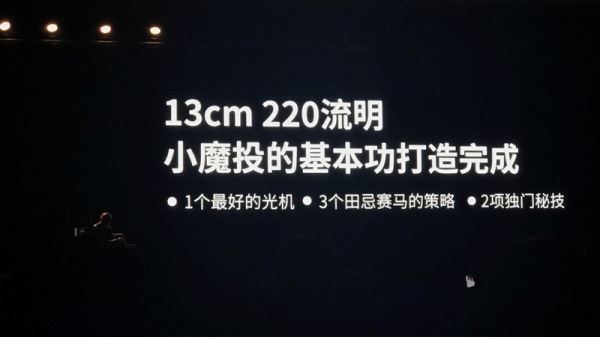

说到便携,首当其冲的就是产品尺寸。小魔投的机身设计为圆形,直径为13厘米,360克的重量也方便携带,出门时可随手塞到裤子口袋。

便携式投影虽然方便,但是一般产品设计相对局限,亮度不够大。小魔投在设计之初就考虑到了这种情况,其搭载了13厘米机身内能装下的最好光机,亮度高达220流明,比目前同尺寸微投的最大流明提升2倍还多。小魔投还采用了三项过往只在高端投影设备上使用的顶级画质技术,包括三千元价位高清投影仪才应用的HDR10技术、DLP影院级技术、6层镧系玻璃镜片,通过暴风TV30余项专业画质技术加持,大幅优化小魔投的画质细节、色彩饱和度和清晰度,让画面更真实。并通过独有的暴风左眼引擎技术,将亮度提升30%以上,让画面更亮更清晰。

“选片困难症”被治愈

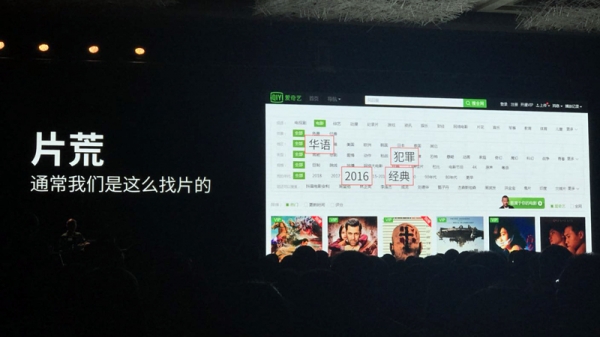

传统的电视/投影仪界面,想要找到心仪的电影往往要花费好长的时间,翻着翻着也容易产生疲倦心理。冯鑫作为资深影迷,也被这种情况所困扰。

小魔投根据痛点做出了相应调整,首页仅有12部影片,以极简的呈现方式缩短用户在观影前无效的选择时间。

另外,为了解决找片难的困扰,小魔投推出了全新的“1994电影引擎”。基于极致片单、可互动、人与片单及行为协同过滤的魔性推荐四个设计思想,小魔投第一次实现了看片和选片分离的极致观影模式,基于小魔投APP,以最简单的滑动操作实现日常找片。用户可通过 “1994电影引擎”随时随地选好电影。在小魔投APP里,左右滑动浏览电影智能推荐信息流,上滑即可实现同类电影的原地换片推荐,下滑即可加入待看片单。让用户轻松滑到喜爱的电影,想找随时找,想看随时看。

没有遥控器,“咔哒”一声的操作体验

暴风小魔投就是要给投影仪“做减法”。

为了彻底做到找片和看片分离,小魔投是第一款没有遥控器的随身影院。用户在平时找片时,通过小魔投APP完成。使用小魔投时,小魔投APP即可完成播放和控制的所有功能。摆脱遥控器,指点屏幕,随时随地享受影院级观影。

小魔投还采用了Macbook同款航空级铝镁合金纯金属外壳,用42元的成本为每个小魔投产品设计了旋转开机。冯鑫希望“咔哒”一声的旋转开机,变成小魔投观影的专属标志,让每次观影都充满仪式感。

多种形态的小魔投,打造互联网放映厅

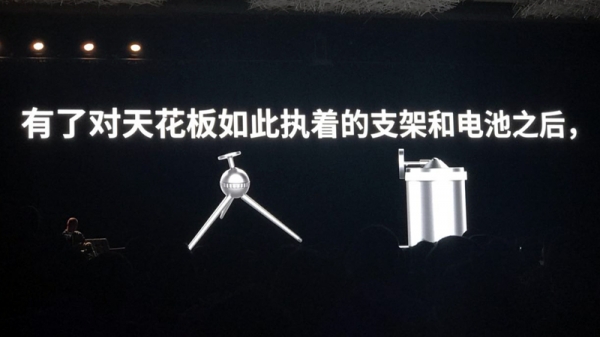

为了让用户轻松找到看电影的那面墙,小魔投特地为用户打造了一款“神奇支架”。采用了航空级铝镁合金和磁吸底座,可360度自由视角随意旋转,轻轻一放即可稳定投影。同时还设计了一款24000毫安时超大容量的电池,可轻松连续播放两部电影。不仅可携带乘机,还能变身为支架,侧身90度调节,投射天花板。

暴风小魔投不止于观影,还是一款新型的互联网放映厅。小魔投发布即开始测试放映厅功能,用户可以开设线上放映厅,挑选钟爱的电影与其他用户分享,并组织映前介绍、映中彩蛋和映后聊天讨论。普通用户也能随时参加一场由电影大V、朋友或普通用户发起的放映。

暴风小魔投将在天猫商城、京东商城、暴风商城(mall.baofeng.com)、暴风TV官网(bftv.com)首发售卖。将于5月23日开启预售,并于6月1日0点正式发售。用户在天猫预约抢购可立减200元,并享50元购物津贴。预约前10名将获得618元购机机会,前1000名即返100元红包。首发福利标准版低至1799元、火版低至1299元。

好文章,需要你的鼓励

AI和物联网技术变革宠物预防性医疗保健

英国宠物慈善机构PDSA数据显示,超过半数宠物主担心无法承担兽医费用。科技公司正通过AI和物联网技术解决这一市场需求。在伦敦兽医展上,多家初创公司展示了创新技术:AI for Pet利用视觉AI分析宠物眼部、皮肤等图像提供健康洞察;Sylvester.ai开发AI模型识别猫咪疼痛表情;VEA整合患者数据自动化诊断。此外,智能项圈等物联网设备可追踪宠物健康症状。这些技术有助于宠物主采取预防措施,降低兽医费用。

卡内基梅隆大学突破性研究:无需训练数据也能让AI学会图像编辑

卡内基梅隆大学联合Adobe开发出革命性的NP-Edit技术,首次实现无需训练数据对的AI图像编辑。该技术通过视觉语言模型的语言反馈指导和分布匹配蒸馏的质量保障,让AI仅用4步就能完成传统50步的编辑任务,在保持高质量的同时大幅提升处理速度,为图像编辑技术的普及应用开辟了全新道路。

北欧国家联合打造AI产业:微软谷歌成关键推手

北欧国家启动统一人工智能产业计划,旨在通过合作在全球舞台上竞争,获得微软和谷歌支持。10月成立的新北欧AI中心获得350万英镑初始预算,但谷歌和微软是唯一提供资金支持的科技公司,具体金额保密。该中心将开发生成式AI系统并建设应用AI服务的系统。北欧教育部长承诺追加资金开发大型北欧语言生成AI模型。尽管资金有限,但北欧国家希望通过联合力量在AI竞赛中提升地位。

复旦大学团队突破AI生成“复制粘贴“痛点:让多人脸AI不再千人一面

复旦大学团队突破AI人脸生成"复制粘贴"痛点,开发WithAnyone模型解决传统AI要么完全复制参考图像、要么身份差异过大的问题。通过MultiID-2M大规模数据集和创新训练策略,实现保持身份一致性的同时允许自然变化,为AI图像生成技术树立新标杆。